11月17日,美国人工智能领域创业公司OpenAI发布声明称,山姆·奥特曼(Sam Atlman)将辞去首席执行官职务并离开董事会,该公司首席技术官米拉·穆拉蒂(Mira Murati)将担任临时首席执行官。声明称,奥特曼离职之前,董事会进行了审慎审查,得出的结论是,他在与董事会的沟通中没有始终保持坦诚,妨碍了董事会履行职责的能力,董事会对他继续领导OpenAl的能力不再有信心。同时,另一位核心创始人兼总裁格雷格·布洛克曼(Greg Brockman)将辞去董事会主席职务,并继续担任公司职务,向首席执行官汇报。声明发布后立即引发广泛关注。虽然宣布山姆·奥特曼离职的声明中并未提到他“不坦诚”的原因,但从OpenAI的股权架构、董事会构成以及创始人之间的博弈冲突中折射出AI企业治理的典型问题。

单一董事会控制非营利公益组织与营利性子公司,治理目标存在天然矛盾。

山姆·奥特曼作为OpenAI的核心创始人,被媒体称为“ChatGPT之父”,为何会在OpenAI成功发布ChatGPT等产品不到一年突然被罢免?更令人难以置信的是,当事人奥特曼和董事长布洛克曼此前却并未收到董事会的任何通知,奥特曼在被解雇的前一天还代表OpenAI在亚太经济合作组织会议上发表了讲话。OpenAI发布的声明称是经过“审慎审查”做出的决定,那么这个过程是到底是如何进行的?在既没有股东会也没有通知董事长和CEO的情况下,由一位联合创始人苏茨克维(Ilya Sutskever,首席科学家)和三位外部董事以4:2的投票做出罢免决定,他们是否有权这样做?

这要从OpenAI的治理架构和董事会构成说起。

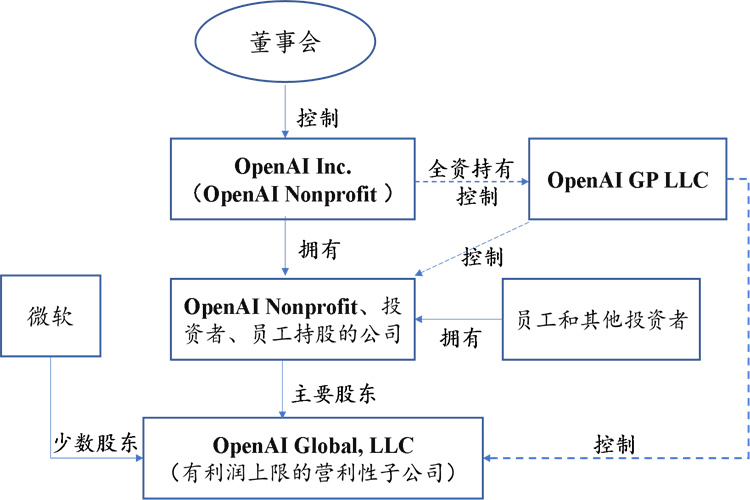

从OpenAI官网发布的治理架构来看,OpenAI Nonprofit非营利组织通过全资持有和控制一个管理实体(OpenAI GP LLC)来控制和管理营利性子公司(OpenAI Global, LLC)。营利性子公司(OpenAI LP)是一家有限合伙企业,在组织形态上采用的是有限合伙制,其中包括一些投资者作为有权获得公司收益的合伙人,而OpenAI Nonprofit则担任有限合伙企业的普通合伙人(GP)。

OpenAI Nonprofit通过其董事会对OpenAI LP进行监督,对营利性子公司具有绝对的控制权。投资者作为合伙人拥有相应的权益,但不直接参与公司的日常运营。因此,OpenAI没有股东会。目前共投资OpenAI 130亿美元的最大有限合伙人微软被定义为营利性子公司的少数股东,但没有该公司董事会席位。而对于OpenAI Nonprofit的董事会,则是无人持股,6名董事采取一人一票制。由于没有股东会,OpenAI Nonprofit的董事会便拥有独立的权力包括解聘CEO在内的最终裁决权,因此非营利组织董事会以4:2的投票做出解雇奥特曼的决定并没有违反公司制度。

从OpenAI官方公布的股权架构中可以看出,目前非营利公益组织与营利公司由单一董事会控制。董事会成员除了Greg Brockman(董事长兼总裁)、Ilya Sutskever(首席科学家)和Sam Altman(CEO)三位创始人以外,其他3位皆为外部董事且不持有OpenAl的股权。而非营利公益组织与营利公司的设立目标本身存在矛盾。

OpenAI的目标是致力于通用人工智能(Artificial General Intelligence,简称AGI)的研究机构,其目的是要确保这项技术被安全地开发出来,并造福全世界。为了减少利益冲突来影响这一使命,山姆等创始人通过非营利性组织OpenAI Nonprofit确保这一目标的实现。而有限合伙企业(OpenAI LP)的出发点是在达成公司目标的前提下,让投资者和员工获得有上限的回报。OpenAI LP的利润超出这个上限的部分,将继续投入到OpenAI Nonprofit这个非盈利实体中用于AGI的研究。 因此非营利组织和营利企业的目标本身存在天然矛盾,这也为OpenAI董事会内部产生冲突埋下伏笔。

OpenAI股权结构

资料来源:OpenAI官网(https://openai.com/our-structure)

OpenAI高层动荡根源在于人工智能“向善”还是“向利”的治理理念冲突。

OpenAI对奥特曼的罢免声明中措辞十分严厉,从此前该公司的相关消息中可以看出OpenAI董事会内部产生冲突的根本原因在于治理理念冲突。

首先是激进发展与初始愿景之间的冲突。OpenAI设立的初衷和使命是确保人工智能(AGI)造福全人类,主要是通过试图建立安全的AGI并与世界分享利益。但是在发展过程中,OpenAI似乎偏离这一目标。例如发布最强“通用”NLP模型GPT-2却不开源、依赖大量的计算资源投入迭代产品等种种事件表明,OpenAI与创立之初所声明的那个“人工智能非营利组织”已然不同。在ChatGPT成型并开始进入大规模应用后,OpenAI开始在商业化之路上一路狂奔,包括推出付费版产品、定制化企业版等。奥特曼提出 GPT 商店和收入共享计划,显然与非营利组织的使命背道而驰。由此,奥特曼与苏茨克维在盈利与建立安全的AGI问题发生分歧。奥特曼和布洛克曼主张积极推进商业化应用,试图扩大OpenAI的业务范围,并且张罗下一轮融资;而苏茨克维等非营利派则坚持要研究安全和造福人类的通用人工智能,主张在盈利方面不能急于求成。因此,创始人的激进与野心和OpenAI董事会非盈利和造福全世界的理念背道而驰,也引发了董事会内部激烈的冲突。

其次是商业化与安全的矛盾。非营利性和安全是OpenAI董事会的两大目标。但最近OpenAI却在用户安全问题上面临越来越多的指责和担忧。围绕OpenAI安全的担忧主要来自数据问题,不少人担心和ChatGPT对话过程中会泄露数据。今年年初,意大利数据保护局(GPDP)指控OpenAI违反了欧盟的数据保护法,目前该案件还在审理中。最近的一次关于OpenAI安全性的争议是11月9日,微软在内部网站的更新中提到了“安全和数据问题”,因此切断了员工使用ChatGPT等AI工具,在一天后又恢复了使用。但只要OpenAI还在追求营收增长,就必然会面临数据安全的挑战。OpenAI设立之初宣告试图建立安全的AGI并与世界分享利益,目前看来,OpenAI在奥特曼的带领下逐渐偏离了公司的使命。作为创始人的奥特曼对名誉和财富的追求超过了对人工智能安全和伦理的重视,这一系列问题导致了他与董事会其他成员产生分歧,与公司发展愿景和公众期待不符,成为他被罢免的原因。

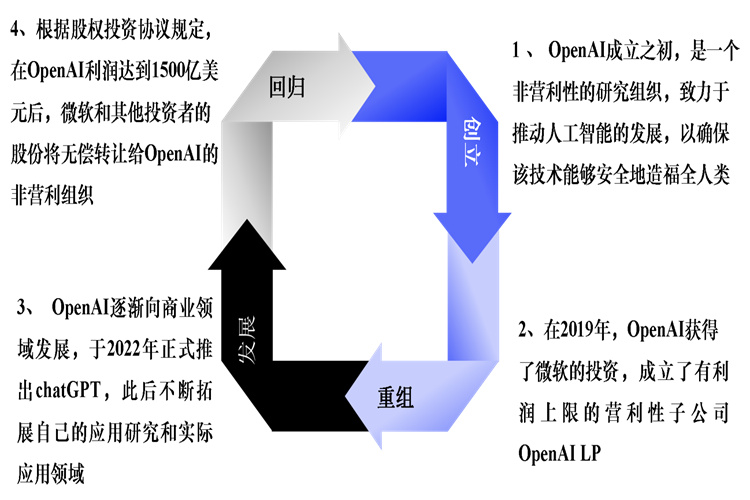

最后,OpenAI董事会冲突的根源在于AI向善与AI企业盈利性之间的矛盾。OpenAI设计了一种独特的股权投资协议模式,未来盈利后的OpenAI的利润分配将按照四个阶段进行,最后在OpenAI利润达到1500亿美元后,微软和其他投资者的股份将无偿转让给OpenAI的非营利组织。从这种设计来看,OpenAI将经历“创立—重组—发展—回归”的逐渐“向善”之路。

AI技术的发展通常受到商业竞争的驱动,AI企业需要获得利润以持续投资和创新。这意味着在追求经济利益的同时,AI企业可能会陷入经济和伦理取舍的困境。这正是处在发展阶段的OpenAI正在面临的问题,也是引发其董事会冲突的根本原因。奥特曼作为CEO迫于支持研发投入和外部竞争的困难,需要在OpenAI中注入更多的商业元素,而对于利润的追求也是他作为CEO的职责所在,所以其本身被罢免不是存在渎职行为,更多的还是人工智能营利和非营利、公益性还是商业化的分歧。而上述两种治理理念的冲突始终困扰着奥特曼和他的创业伙伴,不仅导致马斯克2018年因理念分歧离开OpenAI董事会,也引发了一群员工在2020年出走与创立竞争对手Anthropic。

AI企业向善之路:OpenAI的发展路线

决策者的出发点是实现公益性美好愿景还是商业化目标,决定了人工智能是以安全和造福全人类的“向善”前进还是以盈利为目标的“向利”发展,不管是谁出任CEO都将面临这一问题,解决问题的关键是AI企业治理结构和机制的设计。

风波还在继续,解决AI企业治理问题才是关键。

奥特曼被罢免后,共同创办人董事长兼总裁布洛克曼也随即宣布辞职。此后一天,据称包括微软在内的OpenAl主要投资方向董事会施压,要求奥特曼复职。19日,微软首席执行官纳德拉突然宣布,奥特曼和布洛克曼及其同事将加盟微软,领导一个新的人工智能研究团队。OpenAI的员工们也在社交平台上力挺奥特曼回归,数百名OpenAI员工开始签署联名信,要求所有现任董事会成员辞职、恢复奥特曼的职位,包括临时CEO穆拉蒂也支持奥特曼回归。但很快,OpenAI董事会直接把穆拉蒂的临时CEO身份也“罢免”了,并找来了亚马逊旗下游戏流媒体平台Twitch联合创始人埃米特·谢尔(Emmett Shear)担任OpenAI的临时CEO。令人意想不到的是,11月20日晚苏茨克维发文称自己对参与董事会行动“非常后悔”。到目前为止,OpenAI的人事变动风波仍在继续,但可以肯定的是,企业内部的动荡显然不利于OpenAI价值的提升和未来发展,不仅造成关键人才的流失,还会影响投资者关系和信心,面临财务和技术上的双重困境。

技术研发需要不断的资本投入,坚持纯粹的非营利属性显然比较理想化,微软等投资人也同样重视投资回报。但大规模激进的商业化行为将导致人工智能大模型的安全问题,忽视人工智能安全和伦理问题将会给人类社会带来无法预知的后果。从OpenAI的这场罢免风波来看,良好的治理结构和治理机制设计是AI企业能否良性运作、持续发展的基石。当前,AI企业亟需建立内外部治理体系。

一是推动企业董事会建设,完善治理架构和治理机制。OpenAI应尽快解决单一董事会控制的局面,对于非营利组织和营利性子公司应组建不同的董事会,同时完善治理机制,明确董事会职责,充分发挥非营利组织董事会对营利性子公司决策监督和规范作用,同时协调安全和商业化等方面的目标。

二是将风险治理、人工智能伦理问题嵌入决策。AI企业应在董事会设立专门的伦理委员会,并在公司章程中对AI伦理委员会的构成及其运作进行明确,判断和把握技术应用的方向。设置首席人工智能官(CAIO)或首席伦理官(CMO),以牵头制定专门的人工智能发展战略。

三是建立内部数据合规审查机制和内控机制,确保在研发和数据使用中的安全合规。设置合规部门,建立对数据安全问题的风险评估和防范机制。

四是实施全面的人才培训计划,使管理人才和研发人员了解人工智能技术的伦理和社会责任,增强他们对向善的公司价值观的理解,培育出一个能够在技术和伦理之间取得平衡的企业文化。

五是全面升级治理体系,强化绿色治理和应急治理。AI企业治理应突破作为单纯追求经济效益最大化的传统企业治理边界,而应更多的承担作为社会资源配置平台的社会责任,树立推动社会可持续发展的社会化目标。(南开大学中国公司治理研究院 李维安 唐梦兰)

|